近日,第 61 届计算语言学协会年会(ACL 2023)在加拿大多伦多落幕。ACL全称是Annual Meeting of the Association for Computational Linguistics,由计算语言学协会主办,Google Scholar h5-index为169,是自然语言处理领域最具影响力的国际学术会议。今年 ACL 官方共收到全球约 5000 篇投稿,并在其中评选出六大奖项,共 75 篇论文获奖。

本届会议,除了实施全新的奖励政策,鼓励更多优秀研究者外,华人学者则成为了本届 ACL 的另一大亮点——在所有获奖论文中,有华人学者参与的研究几乎占据半壁江山,国内众多高校、企业、研究机构也都榜上有名,成为 ACL 的“中流砥柱”。

华人团队强强联合

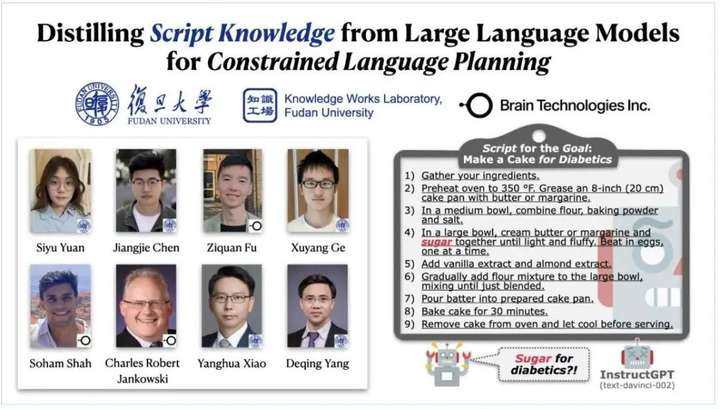

在获评“杰出论文”的 39 篇中,有 6 篇的作者全部由华人研究者组成。此外,很多合作企业或机构的背后,也有华人的身影。例如,与新加坡国立大学共同联合的华为诺亚方舟实验室;与复旦大学联合投稿的硅谷科技公司 Brain Technologies,其核心创始团队也多数来自中国。

复旦大学与 Brain Technologies 的合作始于 2021 年的 NLP 实习生项目。作为全球最早运用单样本学习构建出自然语言处理模型的公司之一,Brain Technologies 的 NLP 实习生项目是全美相关方向申请人数最多的实习项目。每年会收到超 4000 份来自美国顶级高校机器学习或 NLP 方向硕博生的申请,录取率为千分之三。

2021 年起,来自中国的核心创始团队决定将 Brain 的 NLP 项目开放给中国高校,在众多顶尖高校申请者中,录用了数名复旦大学博士生,在团队资深工程师的指导下,参与公司多模态模型和R&D项目的开发。

Brain Technologies 2015 年12月成立于美国硅谷,但核心团队则来自中国。创始人兼 CEO 乐圣(Jerry Yue)12 岁获得全国机器人大赛冠军,后相继被斯坦福大学数学少年班和伊利诺伊大学香槟分校录取。CTO 林源曾以计算机系第一名的身份从清华大学毕业,随后进入哥伦比亚攻读计算机工程学硕士。

2022 年,Brain 推出基于第二代多模态模型 AI 交互界面及开发平台 Imagica,而本次Brain AI和复旦大学获奖论文正是基于该项目研发过程中针对具有特定约束条件目标的规划研究展开。Brain 的三位NLP工程师全程参与了论文的写作、协助研究和指导。其中Soham Shah毕业于加州大学伯克利分校,他参与Brain的R&D模型研究超过四年,加入Brain前任职于IBM Research负责设计多个重点end-to-end多模态深度学习模型,Charles Jankowski参与论文指导,其本科硕士博士均毕业于麻省理工学院。

产研结合为AI进化提供持续动能

过去一年,大语言模型掀起了自然语言处理(NLP)领域的变革浪潮。但作为该领域“顶会”的 ACL 已有 60 余年历史,它早在计算机科学刚刚萌芽的 1962 年便已成立。近半个世纪以来,随着 NLP 研究的不断深入,ACL 也逐渐发展成为全球影响力最强、也最具活力的国际学术组织,会员遍布全球 60 多个国家和地区。

ACL 学术大会每年一度开放相关领域投稿,因其审稿机制规范、审稿质量高,录取率低,能被 ACL 录用的论文往往具备很高的含金量,代表国际学界的认可,被业内誉为“NLP 届奥斯卡”。这些论文不仅持续推动着自然语言理解理论、技术和方法的进步,也培育出了一代优秀的 AI 人才和领袖。

更重要的是,过去几十年间,ACL 一直在用自身的影响力促进着学术成果的落地转化。一方面,ACL 设置的审稿标准,要求论文必须兼具学术创新性与实用价值。另一方面,ACL 也在努力促成学术界与产业界的深度连接——越来越多像 Brain Technologies 这样的企业持续将产业内的数据、资金、技术积累投入学术研究的支持,共同推动 AI 浪潮的创新与发展。

据悉,Brain Technologies 的 NLP 实习生计划将持续面向中国高校开放,期待更多高校教授与团队加入合作。