大模型的聪明程度,不应只看深度学习的“静态脑回路”。因为,层数再多,如果陷入训练即冻结的模式,也只能沦为知识固化的“笨大脑”。

真正的聪明,是需要像人类的大脑一样,兼具实时学习的“动态神经网络”与长期记忆的“海马体”,既能吸收政策变动、用户反馈等新数据,又能沉淀用户习惯、交互历史,形成专属记忆图谱,让模型进化为智能体。

但是,理想很丰满,现实很骨感。

行业现状:几家巨头抢跑“记忆赛道”

目前,已经有一部分大模型厂商意识到长期记忆的价值,并进行了探索。谷歌、OpenAI、微软等科技巨头,纷纷推出了自己的长期记忆解决方案。

2024年12月,谷歌发布了关于Titans的论文,阐释其通过将新增知识压训至神经网络,具备了神经长期记忆技术能力,能做到200万tokens的长期记忆。

同样是在2024年,OpenAI推出了ChatGPT Memory版本。而且在今年4月份,宣布了重大升级:AI将记住你的聊天历史,对话中主动推荐你喜爱的电影演员新作,企业会议自动提炼发言要点,教师可定制个性化学习方案。

今年3月份,微软则通过KBLam技术,这是一种知识库增强的技术,能支持单卡200万tokens,适合结构化知识及专业领域的推理。

那么,他们实现的效果如何?

这几家在一定程度上提升了大模型的长期记忆能力,但谷歌的Titans模型记忆容量和推理效率有待提升;OpenAI的ChatGPT Memory版本主要依靠服务器存储;微软的KBLam技术则更多地适用于结构化知识领域。

在大模型记忆的探索上,行业越来越意识到,真正的长期记忆,必须长进神经网络里。

任度·归藏:让长期记忆长进神经网络里

难道没有一家有新突破吗?当然有。

如果你一直关注大模型行业,你会发现一家名为传神语联的人工智能公司,最近推出了任度·归藏大模型,主打实时学习与长期记忆。与前面的几家不同,任度·归藏通过对新增知识的高效、实时学习,将知识压缩进神经网络。相比于谷歌titans 200万tokens,任度·归藏可以实现500万tokens的长期记忆,能做到长文本理解、复杂任务推理、个性化对话、长期记忆用户习惯等。

值得注意的是,这是国内首个且唯一实现实时学习与长期记忆的大模型。

据了解,在2024年11月,传神语联就已经针对B端场景,发布了具备实时学习与长期记忆的任度大模型,当时还没有一家有这样的能力。任度·归藏则是面向C端,国内也暂未出现同类大模型,国外就是前面提到的谷歌、OpenAI、微软这3家。

由此可见,传神语联在长期记忆赛道上,有两大优势,一是“研究得早”,是先行者。二是“研究得好”,从理论到应用都十分成熟。

那么,任度·归藏是如何做到的呢?

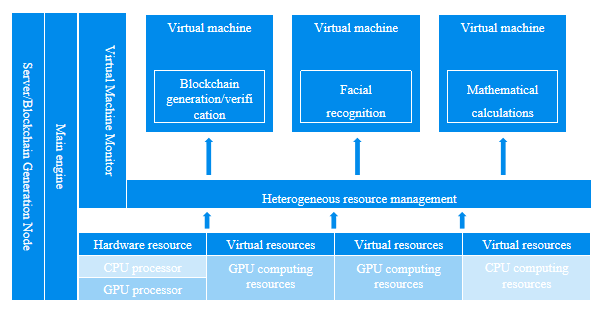

任度·归藏能力的关键在于,其基于自研的机器学习框架zANN构建出来的创新性混合信息熵架构moH。这一架构颇有创新性,是由两个异构化神经网络组成:动态学习神经网络和基础推理神经网络。这两个网络通过共享嵌入层和表示层,巧妙地实现了数据实时学习和推理联动。

在处理用户信息时,外部数据在动态学习网络中训练完成后,其知识被压缩并嵌入到基础推理神经网络中,从而实现了长期记忆。

这种创新性的技术架构,使得任度·归藏具备了高效的学习和记忆能力,还保持了原有神经网络的稳定性和精准度。

大模型的下半场:拼“实时学习与长期记忆”

为什么这么判断呢?

因为究其根本,大模型核心能力在于对文本、图像、语音等多种数据的学习和模式提取。也就是说,只有实时学习用户数据,长期记忆用户知识,驱动用户决策,大模型才有大规模落地的可能。

但是,这个过程面临两个问题,一是如何高效处理海量数据,传统的“大数据+大算力+大模型”一体化架构在处理新增数据时,不能兼顾效率与模型稳定性;二是如何确保用户数据安全。很明显,数据安全问题是企业采用大模型时的一大顾虑,而且,企业把私有数据注入大模型,也会影响模型的推理能力。

如何解决?数推分离是很好的路径。这一方式将数据处理与推理引擎相分离,既高效处理数据,又确保数据安全。

其实,在2024年5月,OpenAI的掌舵人萨姆·奥尔特曼在演讲中提过,GPT-5或GPT-6可能尝试将数据与推理引擎分离。但他仅是提出设想,没有付诸行动。

传神语联就不一样了,理论行动都有。传神语联何恩培认为,“我们应该自信地站出来,因为数推分离是传神语联一直在做的事情,而且已经推出了相应的产品。”

何恩培所说的行动,要追溯到2021年。那时,传神语联在交付一个法律大模型,客户提出了新的需求,“我每天产生的新数据怎么办?能不能让大模型实时学习、实时处理新数据?”就这样,传神语联在法律大模型项目中创造性地实现了数推分离。

由此可见,传神语联对数推分离的研究是有深度的,是延续性的。这也解释了为什么传神语联能先于前面提到的几家国际大厂,在实时学习、长期记忆上能取得一系列进展。

当其他AI还在回答是什么,传神语联已经通过任度·归藏,开始思考为什么这对你重要;当大家还在卷参数,传神语联已经验证了大模型轻量化的智慧之路。可以判断,在大模型下半场,传神语联将凭借先发优势、技术优势,继续深耕实时学习与长期记忆,带来对大模型的超前探索。对于这样的局面,我们充满期待。

免责声明:市场有风险,选择需谨慎!此文仅供参考,不作买卖依据。