从两月前, Sora大模型的发布,如平地一声惊雷,到近日,StreamingT2V的AI视频模型在帧数和视频长度上的突破,全球的注意力都被文生/AI视频生成领域所牵系,生成的视频产品无论是连贯性的场景和运动镜头,还是模拟复杂情境和角色表情,都为AI在理解真实世界场景并与之实现互动,增添了更多细节和想象空间。

Sora可以说是人工智能领域的一次革命性突破,OpenAI更是将Sora定位为“世界模拟器”—— Sora对语言深刻理解,遵循现实世界的逻辑,展现物体运动和交互,甚至是光影的捕捉,这些都符合现实世界的基本物理规律。

然而,已展现了超强算力的Sora在细节的呈现上并不是完美的——在模拟复杂场景的物理效应,以及理解某些特定因果关系时,它可能会遇到难题——比如,视频中的人物可能会咬一口食物,但食物上可能看不到明显咬痕;比如,在处理空间细节分辨左右时,Sora也可能会出现混淆;比如,特定的摄影机移动轨迹时,也可能显得力不从心。

目前,人工智能大模型都由数据驱动,Sora也不例外,她需要“看”到大量的包罗万象的物理现象,进行学习,才能让自身智能真正融合到现实的的物理场景中。世界的运行规律无处不在又极其复杂,人类无法把这个所有的运行细节全部捕捉给Sora们,这也是当前人工智能模型在运行中碰到的待解决难题。

科技界经过漫长的观察实践,捕捉到了世界运行背后的基本规律,并通过第一性原理建立起各种物理定律和数理方程,并在此基础上形成的世界模拟模型——“仿真计算”(CAE仿真)。这一强大的技术,用于生成符合物理规律的数据集,这在许多工程和科学领域中都是至关重要的。对于通用人工智能(AGI)来说,这些数据集可以用于训练和优化模型,以更好地理解和模拟物理世界,这无疑能为Sora们创造出无穷的“粮食”和针对性的“营养元素”。

自然界中大多数物理过程是稳恒态和临界态的交替变化。在临界态(灾变态)中系统骤然突变,很难抓拍到足够的观察数据。因此,临界态的数据样本非常稀少,Sora“看”到的绝大多数都是稳恒态的数据,所以生成的稳恒态的视频让我们叹为观止,但是对临界态的处理,往往又让人啼笑皆非。毕竟,在人类认知中,最为关键的物理事件恰恰是概率几乎为零的临界态。正如在Open AI发布的视频中看到明显的时空不一致,包括违反重力、碰撞动力学、稳固性和物理永恒性。

在以上生成的视频中,我们看到有两个明显的稳定状态:水杯直立和果汁已经泼溅完成的状态。然而,最为关键的临界状态--果汁从杯中流洒出来的过程却未被生成。

究其原因,Sora对物理世界的理解,完全来自于对海量视频的学习。而物理世界的运行规律可能在这些视频里表现出来的都是一些微不足道的细节,并不能完全被Sora所“重视”。幸运的是,这些细节背后蕴含的物理世界的运行规律经过人类漫长的“学习”,已经形成了无数个固定的数理方程,通过求解这些方程,人们能模拟物理世界的真实运行,从而为Sora提供各类符合物理规律的数据,使其能够更好地学习、理解和进而模拟真实世界,实现真正的AGI。

以上的视频由云庐科技生成,是基于计算流体动力学仿真数据渲染而成,当液体从杯子流出时,所呈现的过程更为真实,而这正是目前Sora等不具备物理引擎基底的视频生成模型无法实现的。而CAE仿真技术作为模拟物理世界的核心底层技术,是无缝连接物理世界和数字世界的桥梁,无数的符合物理世界运行规律的数据或视频被“喂养”给Sora们,并基于这些海量视频数据样本进行再训练,让Sora等大模型学习和发现隐藏在这些视频数据背后的物理规律,茁壮成长。

据前瞻产业研究院测算,2023-2025年是我国AIGC产业市场规模增长的第一阶段,增长率维持在25%左右,2025年市场规模达到约260亿人民币。2025年开始,由于行业生态完善(特别是底层大模型完成对外开放),应用层蓬勃发展将带动产业快速增长,年复合增长率将超过70%。如果说,AI是未来10-20年最重要的新质生产力,那么谁掌握了CAE仿真技术,谁就拥有打开未来之门的钥匙。正如英伟达CEO黄仁勋在GTC大会上表达的一样,“数字孪生和生成式AI都是将价值高达50万亿美元的重工业市场进行数字化所需的基础技术”。

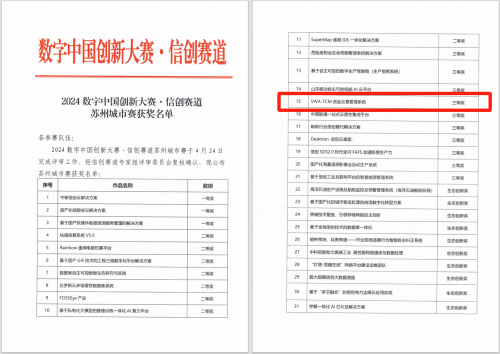

仿真技术及相关软件无疑是未来新质生产力的核心底座之一,全球的创新科技企业对其商业价值的探索也在如火如荼展开,国内科技企业在这一波全球化的浪潮中不落人后,坚持发展工业软件的自主自力,坚持走从中国制造到中国智造的发展道路,研发实力和成果同样取得了瞩目的成就。深耕于仿真计算领域的云庐科技是一家立足于工业软件行业,拥有完整自主知识产权的国家级高新技术企业,搭建了国内领先的全栈仿真计算平台,包括方程式代码生成器,多物理场求解器,仿真云平台,仿真应用云平台等。继2021年发布了“非线性多物理场耦合仿真云平台”, 将多物理场耦合仿真能力提升到一个新的高度后,又于去年9月,发布了全球首款CAE领域大模型——CAEGPT。CAEGPT是基于云庐完全自主研发的CAE内核代码库构建和训练的一个智能生成CAE代码的大模型,它通过输入自然语言文本,能够快速生成各种场景的CAE仿真代码。

如果说,过去的大半个世纪里,在推动人类工业化、信息化进程中的仿真计算领域,已孵育出的大多还是市值百亿美元的欧美公司。那么现在,云庐科技等企业的出现让我们看到了中国CAE公司奋起直追与勃勃生机,看到了跻身世界先进行列的希望。

解决Sora之痛,中国科技公司给出了自己的方案,在未来即将到来的生成式AI改变万物的时代,我们有理由相信中国CAE的明天也将星河灿烂,熠熠生辉。