从多摄手机的普及到安防监控、智能车载摄像头以及机器视觉的飞速进步,CMOS图像传感器成为名副其实的黄金赛道,每年出货量逼近百亿颗大关。

4月17日,在全球CMOS传感器应用技术峰会上,爱芯元智 ISP 系统专家张兴发表题为《关于AI-ISP下一步发展和广泛应用》的演讲,深度剖析了爱芯元智的自研核心技术爱芯智眸AI-ISP,如何打破传统黑光成像局限,实现真黑光全彩实时影像,并揭示了自研NPU在其中的关键作用以及对大模型在端侧应用的前瞻性布局。

真黑光全彩,定义行业新标准

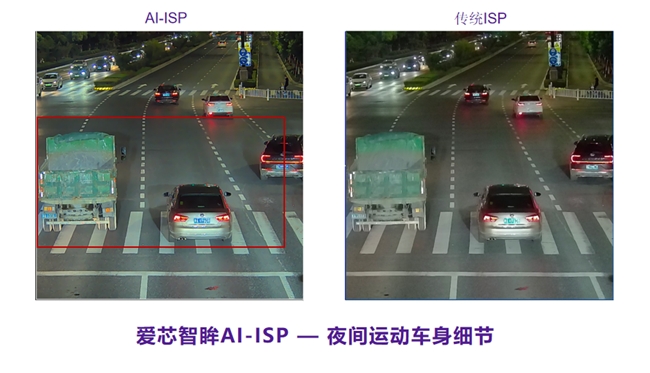

一般来说, 黑光级意味着摄像机可以在 0.01lux 及以下照度的条件下工作。可是,传统的黑光级摄像机往往依赖于大版面传感器、低分辨率、大光圈等手段来捕捉微弱光线,这些方法不仅可能导致色彩饱和度不足、运动物体失真,还伴随器件提升带来巨大成本攀升,难以满足日益严苛的行业需求。爱芯元智首创自研的爱芯智眸AI-ISP,结合了爱芯通元混合精度NPU则颠覆了这一现状,不仅极大提高了AI识别率,还解决了低照和宽动态成像的时代难题,成功将黑光全彩成像变为现实,并且大幅降低设备的综合成本。[a1]

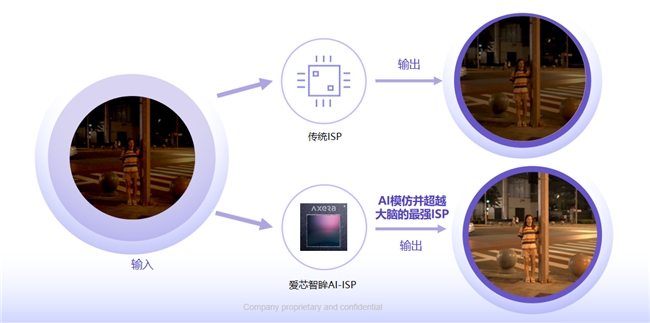

“如果说,CMOS是生物视觉系统中的视网膜,那么,NPU赋能的AI-ISP则是大脑对图像的处理机制。其整合了传统ISP的图像优化功能与人工智能算法,能够对这些初始的数字图像进行深度分析与理解,就像人脑通过复杂的神经网络结构对视网膜传递的信号进行解析,从而识别物体、理解场景并做出基于视觉信息的决策。”

实测数据显示,搭载新一代爱芯智眸AI-ISP的摄像机即使在<0.01Lux的极端暗光条件下,也能在无需任何补光的情况下,以25~30帧的高帧率实现智能降噪和超宽动态成像,实现全彩画面的实时、高饱和度还原,运动物体呈现无拖影、透视或鬼影的清晰影像。

爱芯元智率先提出了“真黑光”六大要素——低照度下无补光全彩、实时帧率、运动物体精准识别、色彩准确还原、成本效益及产品化易用性,强调只有同时满足这些条件,才能在极暗场景下实现卓越的视频效果,切实提升用户体验。

AI赋能ISP,突破传统“天花板”

在全天候条件下,如何提升AI的识别率,达到真正的智能好用,是行业最大痛点。爱芯元智从技术原理出发,对爱芯智眸AI-ISP的架构创新,通过AI赋能ISP Pipeline中的五大关键模块——HDR、3DNR、SR、RLTM和Demosaic,运用AI训练手段持续优化这些模块的性能,有效打破了传统ISP成像的性能瓶颈。成功将有限的算力聚焦于人眼感知最为敏感的功能模块,通过AI化重要模块实现ISP的最佳效果。

大模型[a2]驱动,成就差异化优势

随着大模型的发展,爱芯原智已经率先在自己的 AI-ISP发展中引入大模型技术,促进 AI-ISP 技术发展。爱芯智眸AI-ISP的强大性能背后,离不开自研爱芯通元NPU的有力支撑。

高效能计算:爱芯通元NPU能够同时支持多种数据精度(如FP16、INT4、INT8、BF16等),对于不同类型的计算任务或模型层选择最合适的精度进行处理。在保证模型精度的前提下,大幅降低功耗和发热量,这对于嵌入式或移动设备中的AI-ISP来说尤为重要,有助于延长电池续航和提高系统整体能效。

加速推理速度:爱芯通元NPU通过在不同精度级别上分配计算任务,可以进一步提升硬件利用率和计算吞吐量,缩短AI-ISP在图像信号处理中的推理时间,实现实时或近实时的图像分析和理解。

内存带宽优化:采用的混合精度计算减少了数据传输量,特别是在内存访问密集的操作中,低精度数据占用的存储空间较小,有助于缓解内存带宽压力,减少数据搬移时间,从而突破内存墙限制。这对于AI-ISP处理高分辨率、高帧率的视频流或连续的图像传感器数据时,能够有效降低延迟,提升整体系统的响应速度。

精准性能权衡:爱芯通元NPU允许在推理过程中根据任务特性和模型层的重要性动态调整精度。对于对精度要求较高的关键层,可以使用较高精度(如FP16)以保持精确的特征表达;而对于对精度要求相对较低的层或计算步骤,可以使用低精度(如INT8)来加速处理。这种灵活性使得AI-ISP能够在图像处理链路的不同阶段灵活分配计算资源,实现性能与精度之间的最佳平衡。

系统级集成:爱芯通元NPU直接集成了AI-ISP所需的关键功能,如图像预处理、噪声抑制、色彩校正等,这些功能可以利用NPU的硬件加速特性高效执行,减少对外部CPU或GPU的依赖。这样的集成设计简化了系统架构,降低了数据在不同处理单元之间传输的开销,提高了整体系统的集成度和效率。

适应性强:爱芯通元NPU支持模型的混合精度训练,使得原本在高精度下训练的模型可以经过量化后在低精度模式下运行,无需重新训练或微调即可迁移到AI-ISP中。这种特性增强了AI-ISP对各类预训练模型的兼容性,便于快速部署和更新算法,适应不断演进的AI视觉应用需求。

通过集成高性能、低功耗的NPU,爱芯智眸AI-ISP能够在不依赖DDR内存、保持低延迟和低功耗的前提下,高效执行复杂的ISP任务,显著提升了图像信号处理的效率、准确性和能效,助力实现从图像采集到高级视觉理解的无缝衔接和实时响应, 尤其是NPU的可编程性,使其能够灵活适应不断发展的AI网络模型,确保持续提供出色的性能表现。

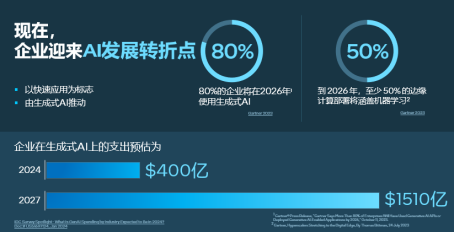

前瞻布局,拥抱大模型时代

随着人工智能步入以大模型为核心的新纪元,爱芯元智凭借其深邃的行业洞察力与前瞻性的战略视野,积极顺应这一变革浪潮。事实上,在三年前爱芯元智擘画芯片蓝图之际,便已精准预见到大模型将重塑AI行业的未来格局。为此,在设计之初就确保芯片原生支持Transformer,无缝对接AIPC时代,从而确保在瞬息万变的市场环境中迅速占得先机。

源于图像处理对实时性、可靠性和隐私保护的高要求,使得AI必然从云端逐步下沉至端侧边缘侧,这对端侧计算能力提出了前所未有的高标准。爱芯元智的第三代、第四代芯片已搭载爱芯通元混合精度NPU,全面支持Transformer大模型的部署,确保在有限的硬件资源下实现复杂模型的本地化运行。不仅如此,爱芯元智还在积极探索如何借助大模型进一步提升AI-ISP的成像效果,从而在大模型时代的竞争中持续保持创新领先优势。

开放合作,共建个性化解决方案

爱芯元智的前端IPC芯片,已成功移植并优化了市场上主流且广泛应用的各类算法,实现了与后端芯片的无缝对接,并与成熟的算法厂商深度合作,通过持续推动成熟、商业价值显著的算法适配,打造出既易于复制,又能迅速部署到各行业的解决方案。

爱芯元智还提供一系列与ISP紧密相关的算法支持,适配多种AI碎片化场景,包括:人车非检测、客流统计、摔倒检测、烟火检测、高空抛物检测、电动车进电梯检测、安全帽检测、垃圾堆检测、遛狗牵绳等等,助力合作伙伴快速实现产品差异化与市场竞争力。

爱芯元智期待与更多算法厂商、硬件方案商及系统集成商等生态伙伴合作,共建开放、多方共赢的算法生态,共同打造普惠AI,造就美好生活。

[a1],并且大幅降低设备的综合成本

[a2]改成了大模型

免责声明:市场有风险,选择需谨慎!此文仅供参考,不作买卖依据。