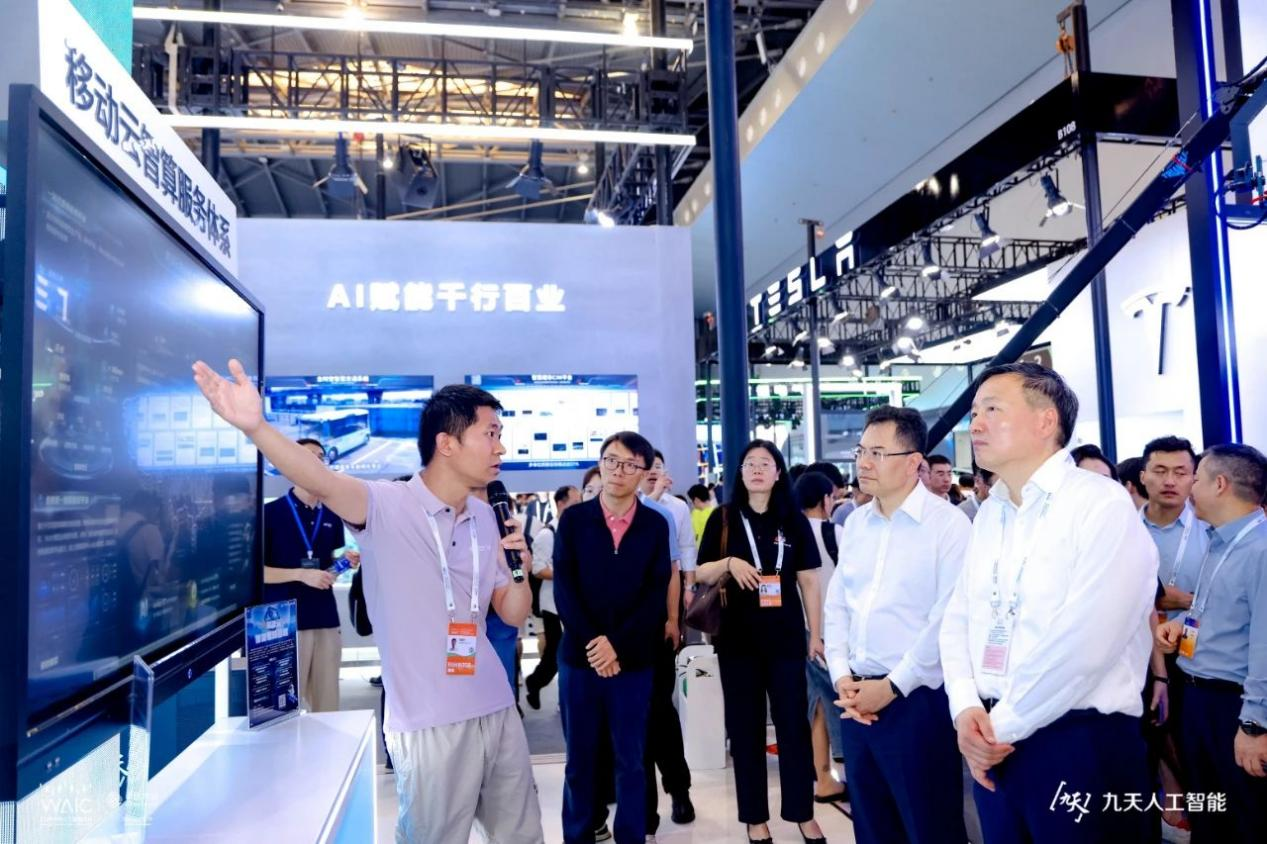

近日,世界级AI科技盛会——2024世界人工智能大会(简称 WAIC 2024)在上海举行。大会聚焦大模型、算力、机器人等重点领域,向外界宣告:AI技术的产业化、商业化进程正在加速推进。

作为数字中国建设主力军,移动云顺应数智化时代潮流,致力于AI+云的融合发展。本次大会,移动云携众多创新成果亮相,与业界伙伴共探数智新未来。

算力、工具、生态,三管齐下

当前,以大模型为代表的新一代人工智能技术变革加速迭代,为“新质生产力”发展注入强劲动力,助力产业智能化升级和经济发展。如何构建技术、服务和应用齐头并进、蓬勃发展的新局面,是当下产业发展的重要命题。

7月4日,在WAIC 2024期间,中国移动举办“AI赋能 云擎智算”分论坛,发布移动云智算产品体系。依托“大云天穹算网大脑”编排调度全域资源、九天千亿参数模型深度调优和海量国产化算力布局,移动云智算产品体系能够提供算力、工具、生态三部分产品能力。

算力就像电,是点亮AI新时代的新能源,但在目前AI发展面临的诸多痛点中,算力供需失衡的矛盾非常突出。作为运营商云,移动云有明显优势和能力予以化解。

AI发展所依赖的强大算力,只有以云为基础的新型算力基础设施才能满足。依托中国移动万卡、千卡智算中心,移动云智算产品体系可为模型构建提供全网调度、开箱即用、异构融合、极致算力利用率的国产算力服务。依据场景通过算网大脑自动编排服务和资源,同时满足高资源利用率、低成本、多端业务等多样化需求。

同时,模型不是直接“跑”在算力上,还需要平台来连接算力和应用,通过各种各样的平台工具,实现基础模型、行业模型到应用的跨越。

移动云打造智算全栈工具链,提供优质数据处理平台、智算训推平台、模型汇聚平台。一方面,提供跨域算力调度、万卡并行训练、断点自动续训、通智边一体化训推服务,加速各行业各场景AI模型稳定开发训练。另一方面,叠加专属于大模型的微调、推理、评估、安全、部署等能力,帮助客户高效完成专属模型构建。

此外,大模型的落地,离不开繁荣的生态。论坛现场,移动云与9家合作伙伴一起,优势互补、资源共享,签署合作协议,携手打造全国最大、最开放的模型生态,共同推动人工智能技术的发展和应用,为客户提供定制化、高质量的智能模型服务。

AI+云=更快、更稳、更好

2024 刚刚过半,我们已经历了好几次 AI带来的技术革新,GPT-4被不断超越。随着企业和科研机构纷纷涌入大模型赛道,国内外各类大模型如雨后春笋般涌现,行业市场的AI+需求骤然爆发。

然而,入局大模型并不是简单的事,涉及许多技术和挑战,企业所面临的不仅仅是成本投入的问题,还有横亘在眼前的三座大山——供给慢、容易断、门槛高。

7月5日,在WAIC 2024“AI赋能 创见未来”生态论坛上,移动云发表演讲《AI+云:让大模型训推更快、更稳、更好》,从算力供给、稳定训推和易用性等方面,向大家深入讲解移动云智算平台在模型训推方面的实际应用。

目前,业界千卡集群供给周期一般以月为单位,未经调优的模型算力利用率仅为20%,资源浪费严重。移动云研发并开源了弹性资源管理架构KOSMOS,实现万卡算力资源分钟级拉起,业界领先。通过数据预热和缓存加速,读写IO提升20%,成本压缩三分之一,千亿参数大模型训练周期从45天缩短到30天。

在训练稳定性方面,千亿参数大模型训练周期大约45-60天,但千卡集群稳定训练时长平均只能2-3天,断点续训恢复缓慢,直接影响模型训练效率。移动云创新提出了“断点不断训”技术,训练中断时长从数小时减少到5分钟,压缩了90%以上。利用这项技术,移动云智算平台实现了千卡20天超长稳训,以一次LLAMA3训练为例,可为用户节约算力租赁成本近千万元。

实际使用过程中,尚存在算力分散、芯片异构、计算框架不同等问题,从“建起来”到“用起来”,算力易用性亟待提升。移动云智算平台提供一体化工具链:依托算网大脑的一体化调度能力,先使用通算处理数据,再通过数据快递跨域传输到中心节点进行训练,最后经由模型框架一键转换,自动推送到边缘异构芯片进行处理,实现“一条龙服务到家”。

大模型的长期价值需要通过行业应用实现。在WAIC 2024 展区,除移动云智算产品体系之外,移动云还展出了自研代码大模型,该模型能够准确理解开发者的意图,将产品需求、原型图转化为高效、精确的代码,从而大幅提升编码效率,优化代码质量,助力企业实现研发管理的数字化转型。

短短几年,中国凭借庞大的市场需求、持续的政策支持和不断涌现的创新力量,在AI领域取得了长足的进步。移动云作为数智中国建设的中坚力量,将持续深入AI+云领域,和社会各界一起,共创美好“AI+”新时代。