在刚刚举办的光合组织领导人大会 AI 技术分论坛上,青云科技分享了在 AI 算力领域的技术探索、产品与服务能力以及在不同场景的落地、与海光的多层次合作等。

让算力“发动机”更强劲

众所周知,算力是新生产力,与数据和算法共同构成数字经济时代最基本的生产要素。在 AI 时代中,算力扮演着“发动机”的角色,它为人工智能提供了强大的计算和数据处理能力,使得 AI 能够更快地进行模型训练、推理和优化。

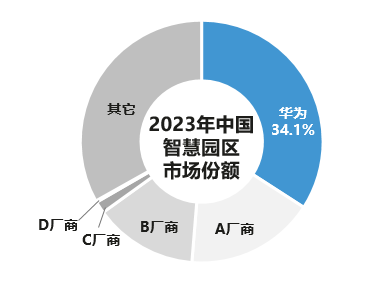

青云科技(qingcloud.com)在服务企业的云基础设施建设过程中,捕捉了企业除了通用算力之外,对超算算力、智能算力的需求,并敏锐洞察了对于多元异构算力的统一调度与管理将成为新型数据中心的重大需求。

在这一洞察下,青云探索全新的技术架构,涉及到异构 GPU 架构、高速无损网络、高速并行文件存储、大规模训练及推理加速优化套件、向量数据库、数据集服务等,同时也在规划如何更好支持自服务与持续运营、支持应用与业务创新。

首先要做到的就是屏蔽复杂的硬件基础设施,将算力、存力、运力、框架、组件以服务方式交付,其次是稳定可靠且持续运行的计量计费平台,并且提供可私有化部署落地的产品方案。建立广泛的智算上下游生态也至关重要。

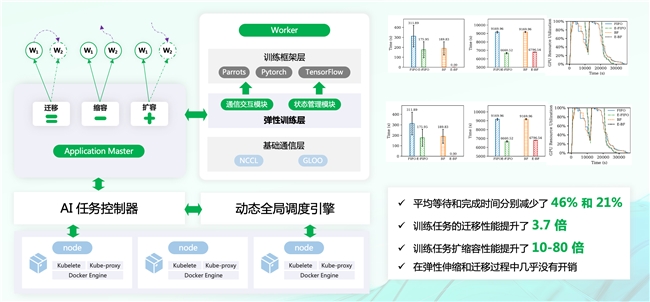

最终,青云通过一个软件平台—— AI 智算平台,实现向下统一调度和管理多元异构的 IT 资源,向上承载大模型、行业应用等,同时通过统一的运营平台和门户,使得“交付、使用、管理、运营”多位一体。

青云 AI 智算平台基于青云云原生底座,在异构资源池化方面也表现优异。如面向人工智能企业的训练场景,最终用户可以快速申请资源,快速搭建计算的分布式训练平台,优化业务和开发流程,打通开发环境、训练环境、数据资源,提高科研效率。与此同时,通过资源动态调整与自动释放,AI 智算平台使得异构算力资源利用率明显提升:假定每人固定分配 1-2 张物理算力卡,统计发现峰值利用率仅 21.8%,平均利用率低于 10%,通过分布式任务调度策略,按需动态挂载和释放算力资源,资源效能节省 60% 以上。

加速企业 AI 落地的最后一公里

青云在 AI 智算领域积极展开生态合作,比如与海光共同打造了全栈国产的异构算力解决方案,同时上线了海光异构加速算力专区, 实现了海光异构加速卡的灵活调度和虚拟化管理。

青云 AI 生态的开放性不仅体现在底层硬件的兼容适配上,也体现在大模型、应用中间件、 AI 应用等厂商与开发者的广泛合作上,通过联合技术创新及解决方案,进一步提升 AI 智算平台的产品能力与服务能力,加速企业 AI 落地的最后一公里。

以 AI 训练场景为例,基于AI 智算平台的“调度”这一核心能力,青云客户可以根据需要灵活编排包括算力资源、存储资源、网络资源以及运维运营等基础要素,并获得敏捷弹性的响应能力、高效智能的管理能力。如此一来,用户 AI 训练的平均等待和完成时间分别减少了 46% 和 21%,训练任务的迁移性能提升了 3.7 倍,训练任务可扩缩容性提升了 10-80 倍。

青云 AI 智算开发平台还支持模型的推理和微调,同时通过大模型服务平台提供完整的大模型场景化落地能力,集成大模型及模型应用开发平台生态能力建设,面向行业领域构建场景化解决方案。

在 AI 时代,青云致力于打造强大、灵活且高效的算力基石,并通过一系列创新的技术和服务,携手更多志同道合的伙伴,推动 AI 技术在各行各业中的广泛应用和发展。