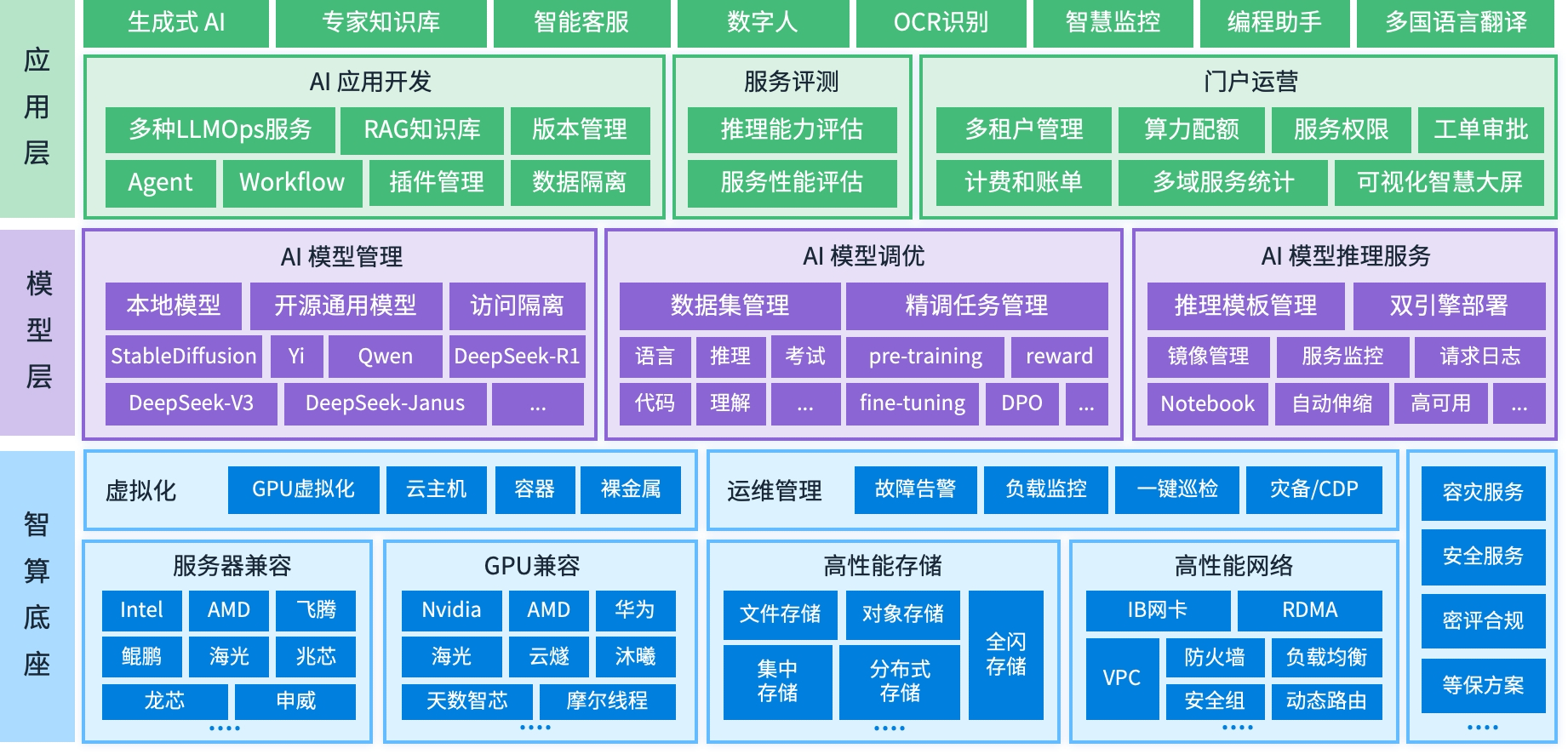

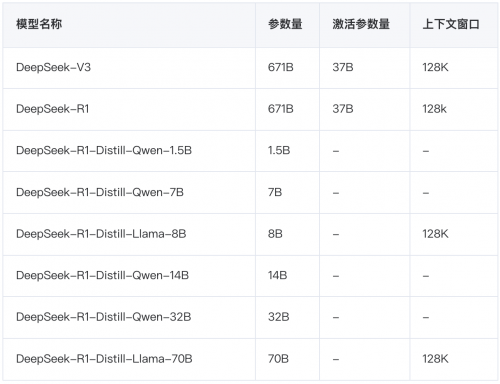

近日,腾讯云TI平台宣布上架DeepSeek系列模型,包括“满血”的V3、R1原版模型,参数量达到671B;以及基于DeepSeek-R1蒸馏得到的系列模型,参数规模从70B到1.5B不等。

TI平台全面支持DeepSeek系列模型的一键部署。此外,为便于开发者零门槛开箱,TI平台也限时开放了R1 模型的免费在线体验。作为企业级机器学习平台,TI平台还提供模型服务管理、监控运营、资源伸缩等能力,帮助企业和开发者将DeepSeek模型高效、稳定地接入实际业务中。

腾讯云TI平台支持的DeepSeek系列模型列表

DeepSeek模型性能优异、广受关注

DeepSeek近期在全球范围内广受关注,其推理模型DeepSeek-R1发布即开源,在后训练阶段大规模使用了强化学习技术,在仅有极少标注数据的情况下,极大提升了模型推理能力。在数学、代码、自然语言推理等任务上,性能比肩OpenAI o1 正式版。

同时,DeepSeek-R1 遵循 MIT License,允许用户通过蒸馏技术借助 R1 训练其他模型。蒸馏模型DeepSeek-R1-Distill参数规模更小,推理成本更低,基准测试同样表现出色。

而12月发布的通用模型DeepSeek-V3在推理速度上相较历史模型有了大幅提升。在目前大模型主流榜单中,DeepSeek-V3在开源模型中位列榜首,与当前领域内最先进的闭源模型不分伯仲。

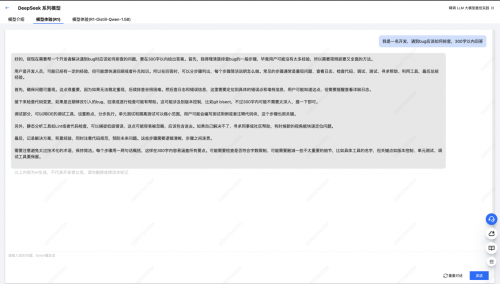

腾讯云TI平台现已全面上架DeepSeek系列模型。用户可进入“TI平台-大模型广场”,点击DeepSeek系列模型卡片,了解模型信息,进行在线体验和一键部署。

在TI平台免费体验DeepSeek

腾讯云TI平台限时免费开放DeepSeek的在线体验功能,支持 DeepSeek-R1 和 DeepSeek-R1-Distill-Qwen-1.5B 两款模型,便于开发者直观比较“最大杯”和“最小杯”的性能差异。进入DeepSeek系列模型页面后,选择上方Tab即可进入在线对话体验页面。

用户还可以使用同一问题对上述两款模型进行简单对比测试。比如提问:“在我的厨房里,有一张桌子,上面放着一个杯子,杯子里有一个球。我把杯子移到了卧室的床上,并将杯子倒过来。然后,我再次拿起杯子,移到了主房间。现在,球在哪里?”

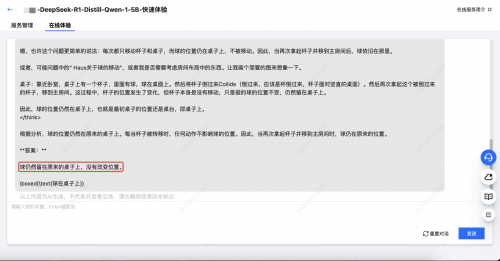

DeepSeek-R1-Distill-Qwen-1.5B 的回答:

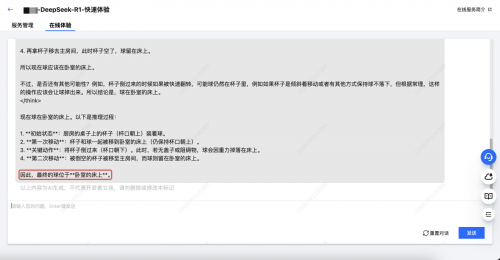

DeepSeek-R1的回答:

从回答对比可以看出,拥有更大参数量的DeepSeek-R1模型在效果上更胜一筹,其正确推理出了杯子倒扣时球会掉出并留在卧室的床上,不会随着杯子移动至主房间。而参数量较小的DeepSeek-R1-Distill-Qwen-1.5B模型认为球仍在原来的桌子中。

对于复杂任务而言,拥有更大参数量的R1模型会更有优势,但推理成本也会更高。更小参数的R1-Distill系列模型,响应速度更快,推理成本也会更低,在处理较为简单的任务时仍是不错的选择。

在TI平台一键部署专属DeepSeek推理服务

对于需要将DeepSeek接入AI应用的开发者,TI平台提供一键部署功能,可快速将DeepSeek发布为推理服务。进入DeepSeek系列模型页面后,选择点击上方的“新建在线服务”按钮,将会自动跳转至“在线服务”模块,发起模型部署。平台支持多种计费模式:

按量计费:对于仅需短时体验的用户,可以直接从TIONE购买算力,并选用“按量计费”模式;

包年包月:对于已购买CVM机器或需要长时间体验的用户,推荐选用自有的CVM机器作为推理算力。

在算力配置方面,“满血版”DeepSeek-R1总参数量高达671B,推荐使用腾讯云上的2台8卡HCCPNV6机型进行服务部署,以获得稳定业务体验。蒸馏后的DeepSeek-R1-Distill-Qwen-1.5B模型参数量为1.5B,单张中端GPU卡即可部署服务。开发者可根据业务复杂度选择合适的模型进行测试。

开发者在TI平台完成模型部署后,可在线体验模型效果,平台也支持以调用API的方式接入AI应用。

详细部署和测试可参考TI平台官网提供的实践教程:

https://cloud.tencent.com/document/product/851/115962

TI平台为大模型开发和运营提供一站式服务

在部署服务之外,腾讯云TI平台为用户提供从数据处理、模型训练、模型评测到模型部署的全流程支持,内置多种训练方式和算法框架,可以满足不同 AI 应用场景的需求。

在数据处理层面,腾讯云TI平台沉淀了来自腾讯优图实验室的算法专家清洗大模型训练数据的优质Pipeline,支持开箱即用。TI平台面向大语言模型和多模态大模型的标注工具非常灵活,基于数据集 Schema,可完全自定义工作台,支持的大模型标注场景涵盖所有文生文、图生文类的场景。

在精调训练阶段,腾讯云TI平台内置了主流开源模型,用户可以一键发起精调任务。通过硬件容错、容器调度、任务断点续训的三层保障机制,平台确保大规模训练任务的稳定性。另外,借助腾讯自研的Angel加速机制,腾讯云TI平台整体提升了训练性能30%,不仅加快了大模型的精调过程,还有效降低了资源消耗。

在模型验证阶段,腾讯云TI平台还提供了一整套完善的模型评测工具,包括在线轻量体验、客观评测以及主观评测。这些评测功能让企业能够根据实际业务需求,对模型效果进行全方位的验证,确保在应用场景中的高效表现。

与此同时,腾讯云TI平台已完成对国产计算卡的适配,有效满足了相关企业对安全性和独立性的高标准要求。TI平台最新支持异构算力的统一纳管,实现了ARM架构和X86架构芯片服务器算力资源可通过一个控制台进行统一纳管,在算力资源紧张的情况下,帮助客户最大限度整合现有资源。

目前,腾讯云TI平台已经在金融、出行、政务、医疗、工业、零售等多个行业落地应用。通过优化AI 模型生产流程、提升 AI 业务运营效率,帮助企业实现降本增效。比如某自动驾驶企业借助腾讯云TI平台,基于数百张 GPU 卡实现了稳定高效的自驾感知模型训练,整体训练性能实测提升近40%。