11月6日,月之暗面正式发布Kimi-K2-Thinking模型,这一重磅模型的落地,让大模型推理部署的硬件门槛问题再次成为行业关注焦点。而趋境科技与清华大学共同开源的高性能异构推理框架KTransformers,已第一时间完成对Kimi-K2-Thinking模型的全面适配,不仅支持用户在单卡环境下顺畅完成推理任务,更通过与主流推理框架SGLang的深度合作,彻底打破了大模型推理必须依赖昂贵多卡GPU的固有认知,为大模型落地提供了高性价比、易操作的全新路径。

KTransformers:获国际顶会认可的异构推理核心

作为入选“计算机系统领域奥斯卡” SOSP 2025的顶尖技术成果,KTransformers的技术实力早已得到国际认可。其相关论文《KTransformers: Unleashing the Full Potential of CPU/GPU Hybrid Inference for MoE Models》与虚拟化、分布式文件系统等里程碑式技术一同亮相这一顶级盛会,足见其在算力利用与系统优化领域的突破性价值。

KTransformers专注于高效利用底层多样化算力,通过对GPU、CPU、内存等硬件资源的精细化调度与协同优化,让大模型能在更低算力、更灵活的硬件架构上稳定高效运行,无论是消费级显卡还是国产化硬件,都能通过KTransformers的适配实现大模型高效推理,这一特性也为其在推理部署领域的创新奠定了基础。

异构协同突破:重新定义CPU与GPU分工逻辑

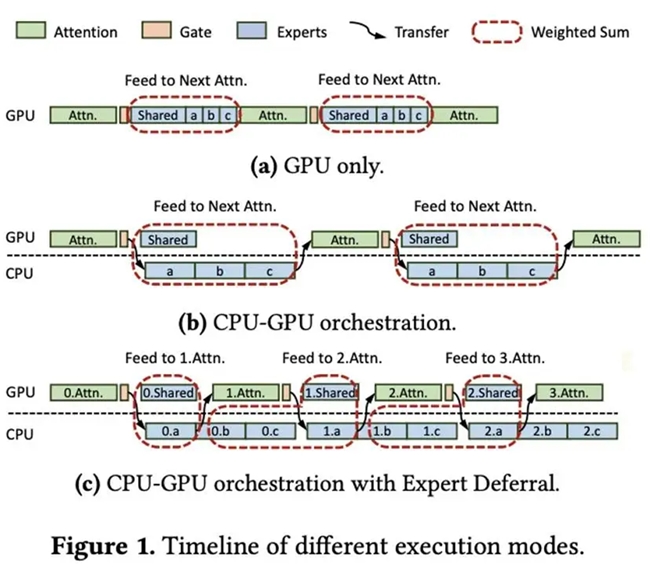

在大模型推理技术路线上,趋境科技走出了一条与传统方案截然不同的道路:打造面向 CPU+GPU异构架构的 MoE 推理系统方案。传统大模型推理模式中,由于注意力机制和主干网络的高并行计算需求,高度依赖多卡 GPU 集群,这不仅推高了硬件采购成本,也让中小团队、个人开发者难以涉足大模型推理领域。

KTransformers与SGLang的合作,不仅带来了低门槛优势,更推动了大模型推理架构的完善。双方融合了GPU+CPU异构推理的创新模式与全 GPU 传统推理模式的优势:既保留了传统模式在高并发场景下的性能优势,又通过异构模式拓展了硬件适配范围,共同推动大模型推理向更高性能、更低成本的方向演进。

目前,这一推理方案已成为更多AI产品背后的底层支撑:全球头部开源模型方如 Qwen、Kimi、智谱 AI 等,在模型发布首日便推荐KTransformers作为推理引擎支持;其工程实践与兼容性也被多家一体机产品线采纳,从互联网企业到传统行业,越来越多的用户通过这一方案实现大模型推理部署,加速了大模型的产业级落地进程。